Sosyal Medya Yapay Zeka Videolarıyla Dolup Taşıyor

Sosyal medya akışlarınız adeta yapay zekâ üretimi video çöplüğüne dönmüş durumda. Son birkaç ay içinde yapay zekâ tabanlı video üreticileri o kadar gelişti ki, artık kameraya olan güvenimiz ciddi şekilde sarsıldı. En iyi ihtimalle, gördüğünüz her videoya şüpheyle yaklaşacaksınız. Geleceğe hoş geldiniz.

Ancak şimdilik, yapay zekâ videolarını ayırt etmenize yardımcı olacak bazı ipuçları var. En dikkat çekici olanı: Düşük kaliteli, bulanık görüntülü videolara karşı tetikte olun. Bu tür içerikler, yapay zekâ tarafından üretilmiş olabilir.

“İlk baktığımız şeylerden biri bu,” diyor Kaliforniya Üniversitesi Berkeley’den bilgisayar bilimleri profesörü ve yapay zekâ tabanlı sahte içerik tespiti konusunda uzmanlaşmış GetReal Security’nin kurucusu Hany Farid. “Yapay zekâ videoları henüz mükemmel değil.”

Ancak bu tavsiye çok uzun süre işe yaramayacak. Yapay zekâ video araçları her geçen gün gelişiyor. Ne kadar sürede tam anlamıyla gerçeği aratmayacak hale gelecekleri bilinmiyor; ama aylar ya da birkaç yıl içinde bu ayırt edici özellikler kaybolabilir. Yine de, şimdilik bu ipuçları size yapay zekâ sahtekârlığından koruyabilir.

Düşük Kalite Neden Tehlikeli?

Açık olalım: Düşük kaliteli video görmek, o videonun mutlaka yapay zekâ üretimi olduğu anlamına gelmez. En gelişmiş yapay zekâ araçları çok kaliteli, hatta profesyonel görünümlü videolar üretebiliyor. Aynı şekilde, düşük çözünürlüklü bir video da kötü niyetli olmayabilir; sadece eski bir cihazla çekilmiş olabilir.

Ancak yapay zekâ ile üretilen videoların düşük kaliteli olması, bazı önemli detayların gözden kaçmasına neden olabilir. Bu da sahtekârlığı gizlemek için bilinçli olarak tercih edilen bir yöntem.

“En gelişmiş metinden videoya dönüştürme araçları bile hâlâ bazı tutarsızlıklar üretiyor,” diyor Farid. “Ama bu hatalar artık klasik altı parmak ya da bozuk yazılar değil. Çok daha ince detaylar.”

Örneğin, cilt dokusunun aşırı düzgün görünmesi, saç ya da kıyafet desenlerinin garip bir şekilde hareket etmesi, arka planda fizik kurallarına uymayan hareketler gibi… Bu tür hatalar net bir görüntüde daha rahat fark ediliyor. Ancak düşük kaliteli bir videoda bu detaylar kolayca gizlenebiliyor.

Son Dönemde Yankı Uyandıran Yapay Zekâ Sahtekârlıkları

Son aylarda milyonlarca kişinin kandırıldığı bazı yapay zekâ videoları sosyal medyada viral oldu. Bu videoların ortak özelliği? Hepsi düşük çözünürlüklü, eski kamera ya da güvenlik kamerası görüntüsü gibi sunulmuştu.

- TikTok tavşanları: Trambolinde zıplayan tavşanlar – 240 milyon izlenme – düşük kaliteli gece kamerası görüntüsüyle paylaşıldı.

- Metro aşıkları: New York metrosunda aşık olan çift – pikselli.

- Sahte vaiz: Muhafazakar kilisede solcu vaiz – aşırı zoomlanmış.

“Uzun vadede video içerikler, metin gibi değerlendirilecek,” diyor dijital okuryazarlık uzmanı Mike Caulfield. “Gerçek olup olmadığını anlamak için içeriğin nereden geldiğini bilmek, nasıl göründüğünden çok daha önemli hale gelecek.”

Uzunluk, Çözünürlük ve Sıkıştırma

"Aranacak üç şey: çözünürlük, kalite ve uzunluk," diyor Farid.

Uzunluk en kolayı: AI videoları genellikle 6-10 saniye. Üretimi pahalı, bu yüzden kısa. Birleştirebilirsiniz, ama her 8 saniyede kesinti fark edersiniz.

Çözünürlük piksel sayısı, sıkıştırma ise detay atar – bloklu desenler bırakır. Sahteciler kasıtlı olarak düşürür: "Çözünürlüğü düşürürüm, sonra sıkıştırma eklerim," diyor Farid.

Gelecek: Gözlerinize Güvenmeyin

Tech devleri milyarlar harcıyor, "Kötü haber: Bu görsel ipuçları yakında gidecek – 2 yıl içinde," diyor Stamm. "Gözlerinize güvenemezsiniz."

Ama umut var: İstatistiksel izler, dosya gömme, AI etiketleme. Gerçek çözüm: Kökeni araştırın.

"Video her zaman gerçek anlamına gelmez artık," diyor Caulfield. "Köken, her şey."

NestJS Nedir?

AI Search Optimization (AIO) Nedir?

Vite Nedir?

Web Siteniz Google’da Görünmüyor mu?

Jamstack Mimarisi Nedir?

QR Menü Nedir?

Docker Nedir?

SEO Nedir?

Nuxt.js Nedir?

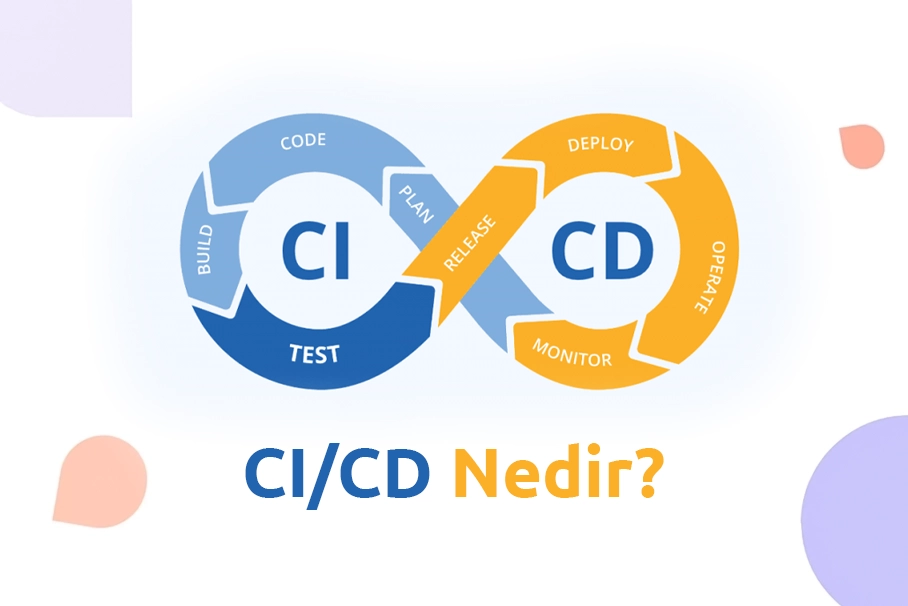

CI/CD Nedir?

Sitemap Nedir?

Headless CMS Nedir?

Meta Tags Nedir?

Mobil Uyumlu Web Sitesi Neden Zorunlu?

TypeScript Nedir?

Astro Nedir?

Core Web Vitals Nedir?

PostgreSQL Nedir?

Hosting Nedir?

Yapay Zeka Destekli Web Tasarımı

Motion UI ve Mikro Animasyonlar

GraphQL Nedir?

Vue.js Nedir?

WebAssembly Nedir?

Browser Cache Nedir?

CSS Nedir?

PWA Nedir?

Remix.run Nedir?

Web Components Nedir?

JavaScript Nedir?

Robots.txt Nedir?

Angular Nedir?

Voice UI ve Sesli Arama Optimizasyonu

Google’da İlk Sayfaya Çıkmak

CDN Nedir?